Hur långt har AI kommit idag?

De senaste åren har det skett enorma framsteg inom AI, och vi ville hitta ett sätt att faktiskt visa vad det innebär. Vi drog igång ett litet projekt för att skapa en helt AI-genererad upplevelse. Filmerna du ser här är skapade av tre olika modeller som samverkar:

- Modell 1: Tränad för att skriva svenska dikter.

- Modell 2: Tränad för att rita bilder (BigGAN).

- Modell 3: Tränad för att förstå sambandet mellan text och bild (CLIP).

Vi byggde ett system som först skriver en dikt, och sedan "animerar" dikten genom att generera ett flödande konstverk med ca 45 bilder per sekund.

Exempel 1

Vårt mål var att testa hur mycket av världen modellerna lyckats "komprimera" (eller förstå), men också att utforska AI:s kreativa potential. Ta kubism som exempel: kuber finns, verkligheten finns. Om du komprimerar dessa två får du något nytt som ändå känns bekant. Är kreativitet i själva verket en form av att titta i mitten av det som komprimeras? Neurala nätverk är mästare på kompression, och om den tesen stämmer är AI ett fantastiskt verktyg för skapande.

I videon instruerar ("promptar") vi modellen att skapa något i stil med två specifika konstnärer. Det ryckiga vi ser är en slags kamp mellan modellens tolkning av konstnärerna, diktens rader och en gnutta inprogrammerad slump.

Exempel 2

Det intressanta med BigGAN är att den är tränad på ImageNet — ett dataset med katter, hundar och bilar. Den är alltså inte tränad för att vara "konstnärlig". Men någonstans mitt emellan en känguru, en kassetspelare och ett kök finns former som liknar robotar eller abstrakta konstverk. Genom att söka i modellens enorma rymd av möjligheter kan man hitta fantastiska saker gömda i det till synes normala.

Fler exempel

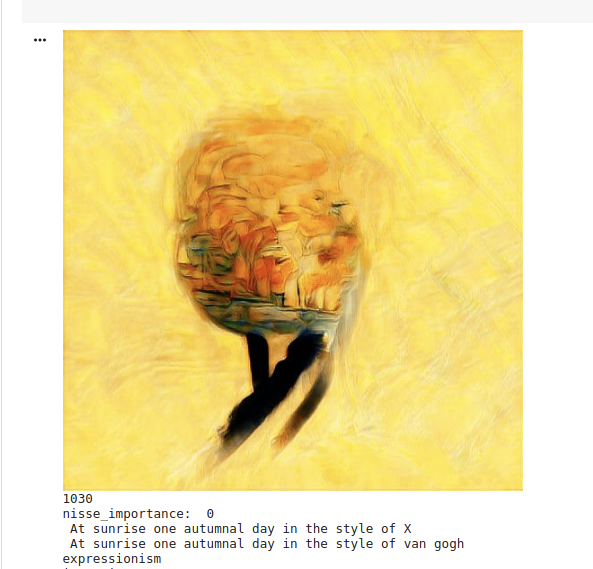

Hjärnan och Van Gogh

Här testade vi att låta modellen ta hänsyn till en specifik bild på en hjärna under skapandeprocessen. Det gav videon en helt annan karaktär där hjärnans struktur vävs in i verket.

Här är ett exempel på ett live-experiment: Hjärna, sol, höst och Van Gogh-inspirerad expressionism.

Vad kan företag lära sig av detta?

Även om det här ser ut som ren lek, finns det praktiska användningsområden. Vi har till exempel använt dessa tekniker för att skapa unika profilprodukter och dekorationer till kontoret. Det här är en personlig favoritvariant av vår logotyp:

Sammanfattning

Modeller som CLIP har blivit otroligt bra på att förstå sambandet mellan text och bild. Det här öppnar upp för en framtid där vi kan konsumera helt personligt innehåll — föreställ dig att kunna beställa en film om Indiana Jones i Jämtland med dig själv som sidekick, och få den genererad i realtid. Infinite content. Tills dess får vi nöja oss med vackra dikter och deras AI-tolkningar.

Sist men inte minst, ett tack till de som tagit fram modeller/arkitekturer för det vi använt oss av:

BigGAN — Large Scale GAN Training for High Fidelity Natural Image Synthesis

Andrew Brock, Jeff Donahue, Karen Simonyan

CLIP — Learning Transferable Visual Models From Natural Language Supervision

Alec Radford, Jong Wook Kim et al

DALL-E — Zero-Shot Text-to-Image Generation

Aditya Ramesh, Mikhail Pavlov, Gabriel Goh, Scott Gray, Chelsea Voss, Alec Radford, Mark Chen, Ilya Sutskever

GPT-2 — Language Models are Unsupervised Multitask Learners

Alec Radford et al

Litteraturbanken — litteraturbanken.se

Metoder inspirerade och utvecklade från Ryan Murdocks ursprungsmetod @advadnoun